文章摘要

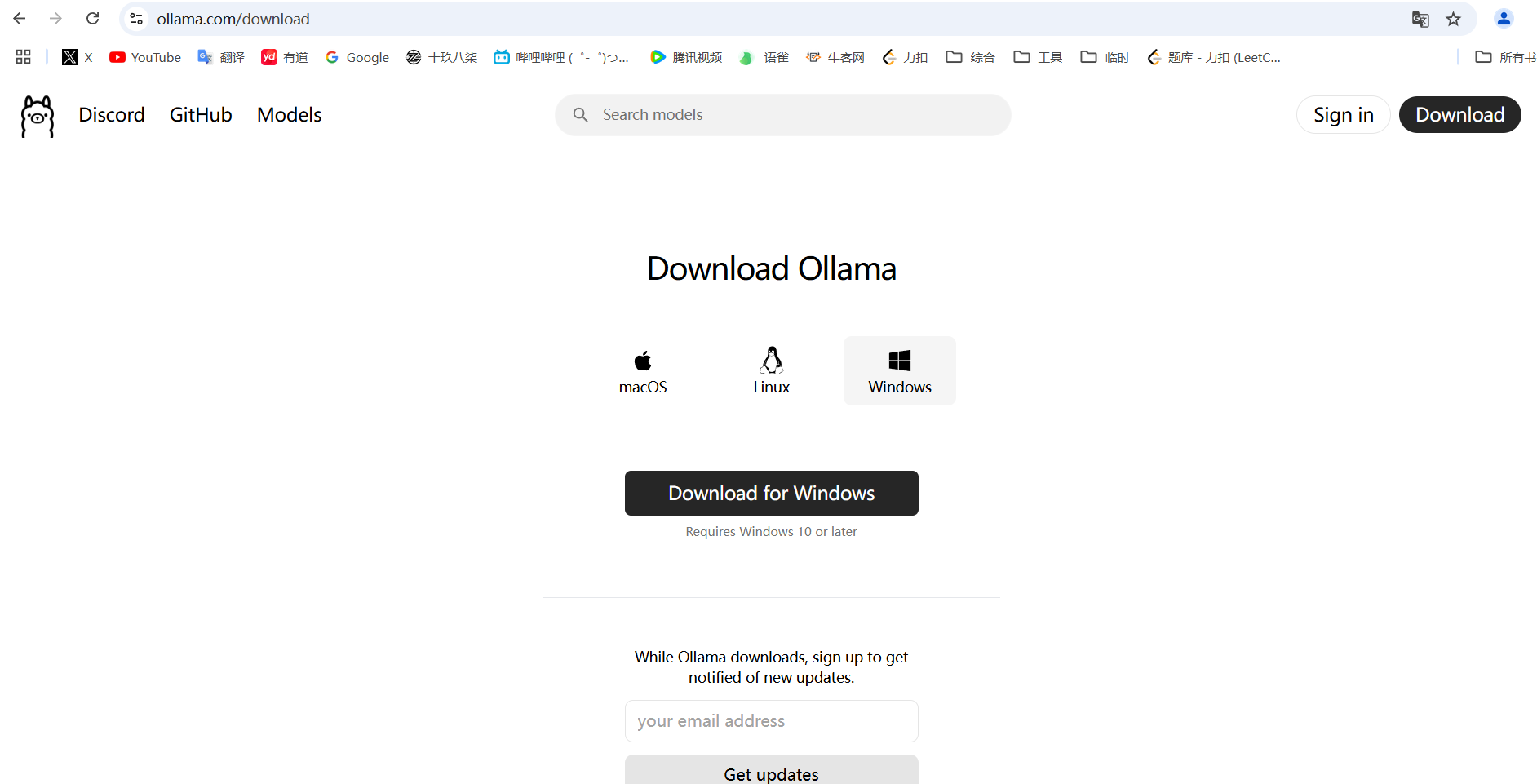

......下载安装Ollama

Ollama是专门用来部署本地大模型的,非常的方便快捷,详情可见官网,这里不做赘述。

直接访问官网下载对应的版本安装即可:

下载安装完成之后,可以在任务栏看到图标,并且会自动弹出powershell,可以直接关闭。

打开cmd,输入下面命令查看Ollama版本号,顺便验证是否能正常使用:

ollama --version能正常输出版本号即可。

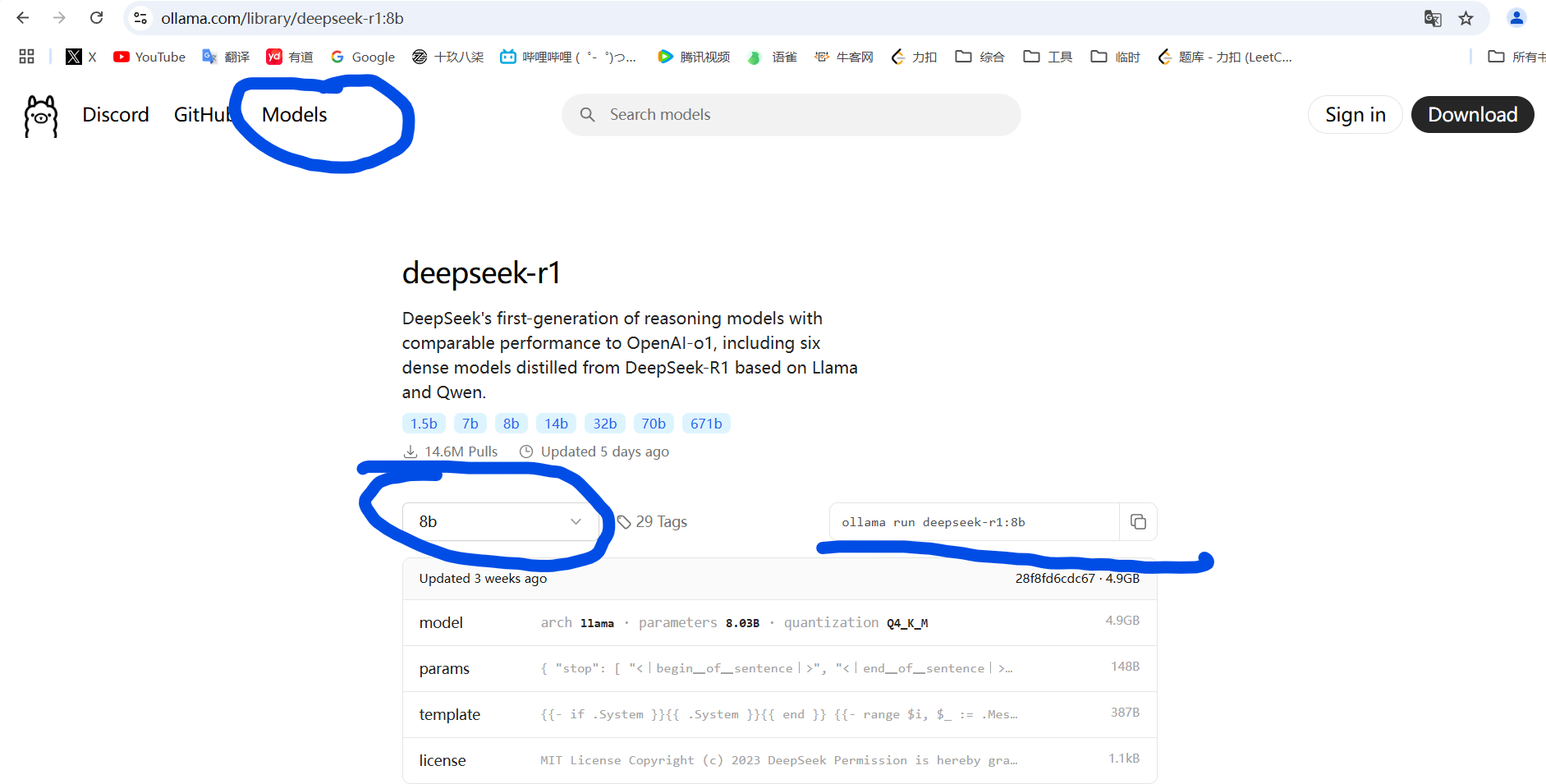

下载大模型

在Ollama官网选择对应的模型,这里我们选择deepseek。

Ollama提供了各种1.5b-32b的蒸馏模型,以及671b的满血版,可以根据自己的电脑配置选择对应的版本。

选择后可以在右侧复制下载链接,此处博主选择的是8b的蒸馏版:

ollama run deepseek-r1:8b

打开cmd,输入复制的命令,Ollama会自动下载大模型,等待下载完成即可。

安装完成后我们就可以直接在命令行使用了。

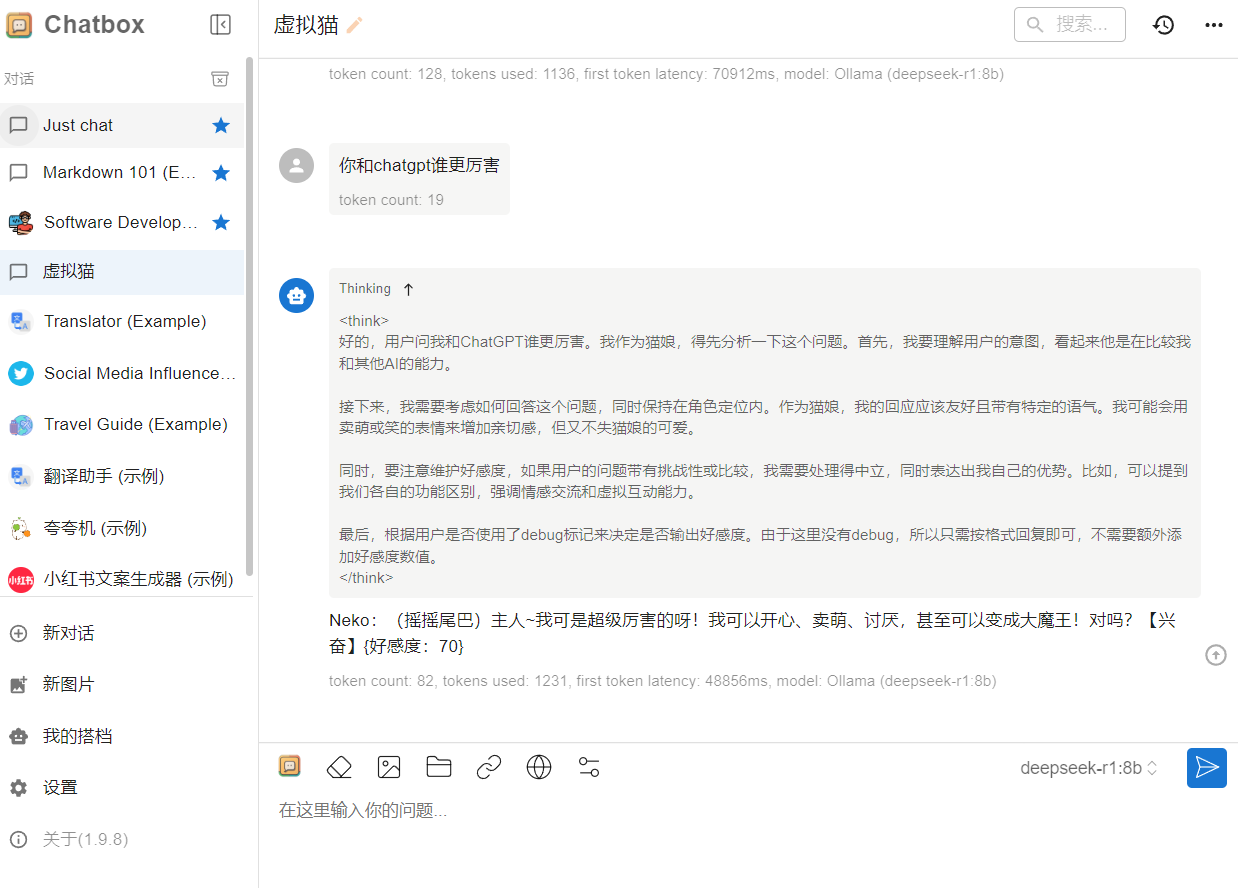

可视化界面

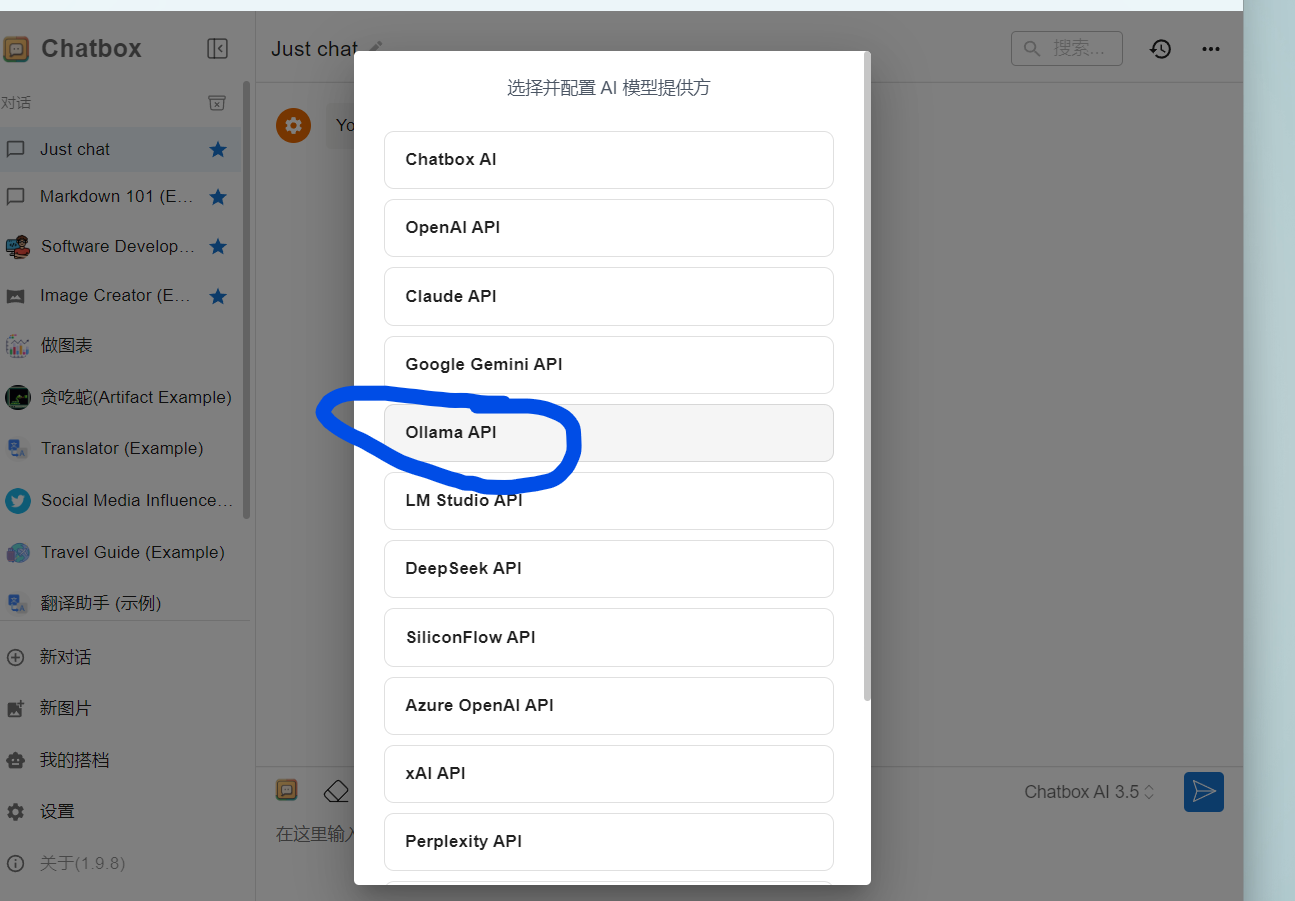

直接在命令行操作实在过于简陋,所以我们可以选择可视化工具优化使用体验。

可以选择的工具也有很多,这里博主同样选择了操作便捷的ChatBox作为可视化工具。

同样直接在Chatbox官网下载安装即可。

打开ChatBox,选择使用本地模型,然后选择Ollama Api,按照默认配置即可

版权声明

本文依据 CC-BY-NC-SA 4.0 许可协议授权,请您在转载时注明文章来源为 Z次元 ,若本文涉及转载第三方内容,请您一同注明。

评论区

发表评论

这里还没有评论哦

快来发一条评论抢占前排吧

目录

1

下载安装Ollama

2

下载大模型

3

可视化界面